某国民种草APP由于涉及内容违规,从安卓应用市场消失了,应该算是最近最火的话题。

作为C2C的种草平台,该APP不仅允许用户线上分享种草清单,还可以发布购买链接,让消费者接受安利的同时可以直接购买商品。二者相结合,就成了完美的导流神器。

其实平台本身只是一个单纯的内容分享社区,所有人都可以来发布任何内容,像半佛仙人文章里提到的一样,对于一起C2C的UGC平台来说,只要是能够发布内容的地方,内容失控的风险都是存在的。评论区、用户昵称、私信区、论坛…..都可能被不法分子利用成为其发布违禁商品、色情引流、博彩诈骗等,从而导致平台内容的失控。

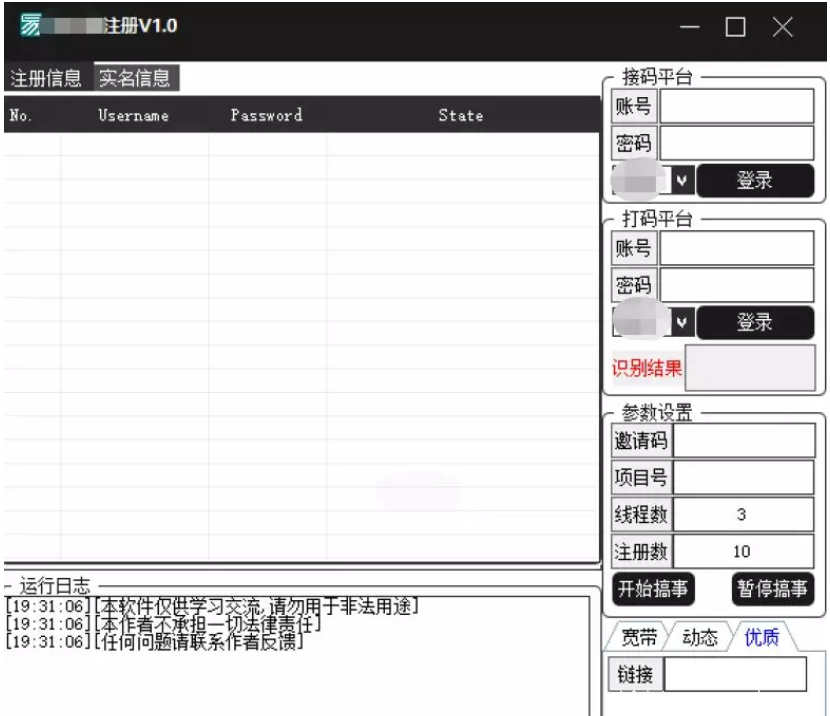

图为:违规信息

内容失控的问题其实也是属于反欺诈风控的一部分,所以本篇文章会从两个方面出发,谈谈企业进行内容治理的现状:一是黑灰产如何利用UGC类平台进行发布违规信息,并进行引流诈骗;二是企业在遇到这类问题的时候,会采取怎样的解决方案。

一、为什么黑灰产发布大量的违禁信息,企业很难识别?

在互联网黑灰产中,无论是行迹匆匆的羊毛党,还是浪迹论坛的水军,拥有各个平台的账号都是他们进入“职场”的第一步,批量注册大量账号就因此成为了所有恶意行为的源头。目前,这条黑色产业链已经形成上中下游的明确分工。首先,处于中游的号商会从上游的卡商那里购入一批手机号,然后利用接码平台、猫池、打码平台、其他自动化工具等批量注册虚假账号;随后,将账号售卖给下游用于薅羊毛、刷量、传播违禁内容等非法获利行为。

图片来网络:猫池

图为:接码/打码平台

内容平台散布违禁内容的源头正是这样一批账号。许多平台都会通过设置安全防护策略,或实名认证的方式在注册/登录环节对它们进行源头的过滤。但平台风控和黑产突破始终是一个持续博弈的过程,当黑产发现,利用新注册的账号发布广告等违规内容很快就会被平台发现并封号之后,他们会先让账号过上一段“正常人”的日子,在平台监控真的认为他们的“正常人”后,再撕下伪装的面具,在平台作恶,这种行为就是“养号”。

“养号党”利用群控技术+自动化脚本批量操控多个账号在平台发帖、留言或者点赞,这一切都是为了模拟正常个人用户的行为,逃过平台的风控规则。

图片来自网络:群控现场

根据威胁猎人的持续监控发现,刚注册的新账号根据不同平台可获利益不同,售价会在0.1-10元不等,在“养了”半年或者更长时间之后,价格就会翻上一番,达到1-100元或者更高的价格。如果账号“拥有了自己的姓名”,价格还能够进一步提升,只要从“料商”处买来身份证等实名信息绑定账号就能实现,此时的账号售价可以直接翻倍,达到10-200元甚至更多(比如微信账号)。

图为:威胁猎人反欺诈情报监测平台监测到的账号售卖情况

被“养过”的账号随后被买到下游黑产手中,用于广告营销、传播违规信息等途径,于是就有了内容平台上出现的黑账号。它们因为模拟成正常账号逃过了平台的防护规则。

之后,通过不断转变敏感词汇的表现形式(如,微信可以变成威信、VX等),黑产就能绕过平台对敏感词汇的过滤规则,再利用自动化脚本就能批量发布违规内容。

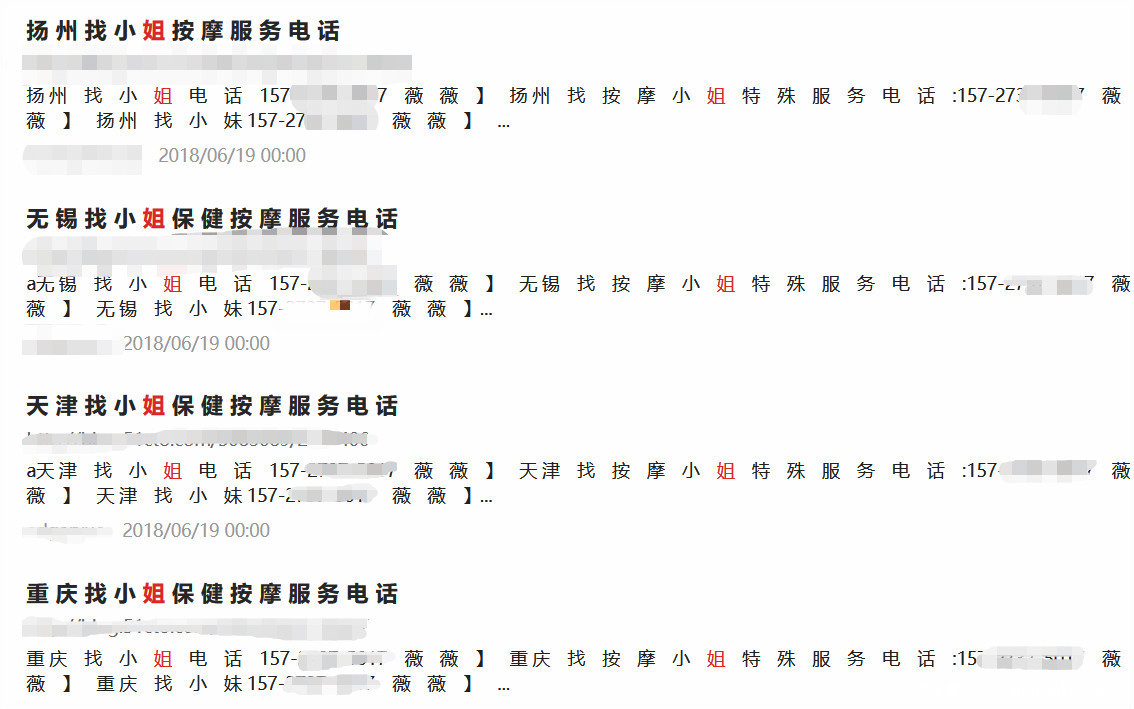

图为:违规信息

不过,其实现在黑产的日子也不那么好过了,这和平台采取的打击措施有关。

许多内容平台,在受到黑产的侵害后,会马上加大对内容的审核力度,通过风控策略拦截恶意账号,或者组建审核团队、搭建数据模型来打击平台作弊行为。

二、防范违规内容产生的基础措施

监管部门加大监管力度,内容平台提高自我审核力度已是目前的常态。强监管下,企业或强化自身审核能力,或与第三方合作探索提升内容安全的方式,但其底层逻辑都比较固定的,就是风控加持审核体系。

1、利用反欺诈风控体系,从源头拦截黑账号

前面说到的机器审核和人工审核机制,都是在违规内容出现之后进行内容管理的一种方式。

但在与黑产攻防对抗的过程中,我们发现,如果能在黑账号进入平台时、发布违规内容前就进行拦截,就能解决很大一部分违规问题。

在平台上发布违规内容的账号,通常是黑产在发卡平台先买入一批手机号,然后利用自动化工具批量注册的。如果平台能够通过账号识别体系,在黑产注册或登录当下就识别并拦截,就能阻止进一步的作恶。

我们在建立反欺诈体系建立过程中,通过对黑产业链核心节点的布控,能够掌握大量的黑产所利用的虚假手机号和恶意IP资源。当黑产利用这些资源进行账号的注册时,就可以在注册或登录环节进行风险账号的拦截或降权处置。

这一层防护体系,就能从源头上解决违规内容的产生。对于漏网之鱼,只要补充内容审核机制,大多数平台的内容安全问题基本都能解决。

2、补充内容审核机制,过滤违规内容

- 利用机器审核过滤违规内容

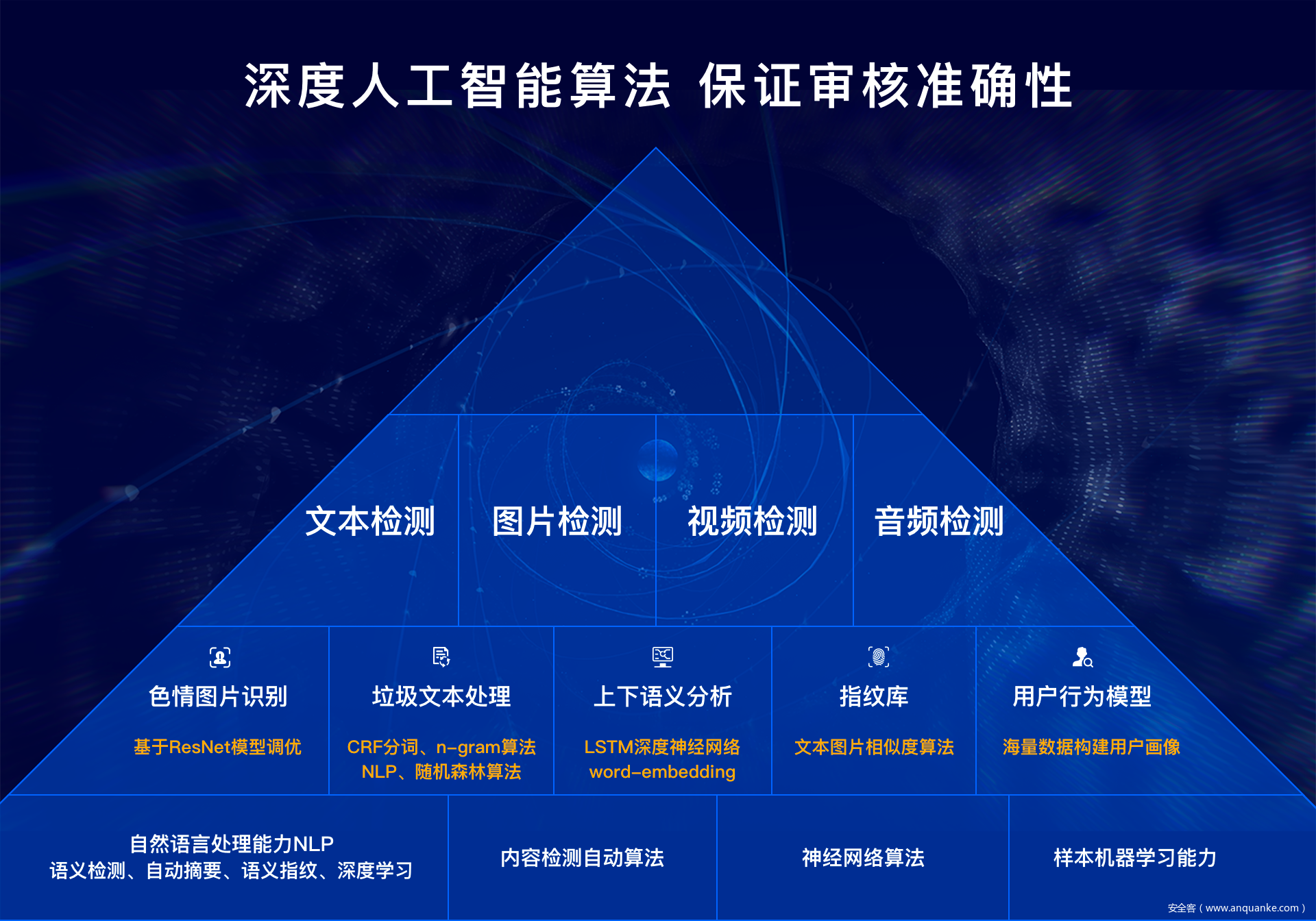

目前,违规信息主要会以四种主要的形式出现在平台上,那就是文本、图片、视频和音频。

文本内容相对来说会比其他三种内容的处理成本低,平台可以自己维护一套动态文本库,持续收集和更新敏感违规词汇,也可以联系安全服务商接入一套外部文本库。其中的逻辑都是一样的,就是通过文本词库过滤的形式,筛选出违规的文字内容,然后进行后续的人工处理或直接删除等操作。

而对于除文本外的图片、视频和音频的视频,往往和人工智能、机器学习技术挂钩。要搭建一整套智能审核体系,需要比较高的成本。因此,对于这类内容,平台会选择接入安全服务商的服务。

图为:机器审核涉及的智能技术

以图片审核为例。在图片上会出现两种违规形式:

- 一种是图片本身的内容是违规属性的,比如,图片中出现有色情、武器、暴力场景的画面;

- 另一种是人为后期给图片加入了违规信息,比如,图片上添加了推广二维码、微信号码、电话号码等内容

针对这两类图片,利用第三方的智能识别技术就能进行识别。而服务商只要不断利用收集到的图片数据信息对模型进行组合训练,保证模型的快速迭代,就能进一步提升识别的准确率。

- 人工辅助审核,降低误判率

充分利用人工智能技术对违规内容进行识别,在很大的程度上,其实就是为了节省人力。但实际上,不管行业把人工智能技术吹得多牛X,就现阶段来说,这项智能技术都会有不够智能的时候,还是少不了人工的辅助。

图为:人工审核+机器审核相辅的审核机制

就拿“扫码”这个词儿来说,它可以变成扌彐 石马,少马,扫**码等各种形式,人工智能并不能精准识别所有变体。另外,对敏感内容的过滤规则设置还不能过于严格,不然,就会出现误杀正常内容的情况。

在这样的情况下,人工审核就是一个必不可少的环节。

不同的平台可以利用机器审核机制设置不同的审核策略,然后对违规内容的可判性打上不同程度的标签,然后进行相应的处理。

比如,对于确定是违规的内容,可以标为【高危】,直接删除或封号处理;对于涉嫌违规的内容,可以标为【中危】,然后给予文字警告;对于命中少量违规内容,但无法准确判定性质的可以标为【低危】,对于低危的内容就可以由人工审核处理,避免造成误杀。

人工审核的环节对于所有做内容的平台都至关重要。目前,比较大型的内容平台,甚至会自己设立人审机制,少则十几人,多则数千人,专门审核平台内容。

写在最后

在具体的实践中,不同平台会有不同的内容展示形式,最终的解决方案和规则设定就会因“平台”而异了。但不论什么平台,都需要认识到的一点是,黑产的攻击手段总是在不断进化,为了躲避拦截策略,会不断出现新的内容发布形式,平台方只有持续关注内容管理解决方案,业务安全方只有不断迭代防护技术,才能在这场“猫鼠游戏”中占据上风。

关于我们

威胁猎人是一家反欺诈服务&内容安全服务提供商,基于领先的反欺诈技术、海量的数据、丰富的安全经验积累,解决互联网行业内存在的欺诈问题。并先后推出业务反欺诈、内容安全等系列服务。我们拥有一整套国内领先的业务安全情报监控与预警体系,形成了强大的黑灰产布控能力。目前已为腾讯、百度、阿里、华为等互联网企业提供业务安全服务。

发表评论

您还未登录,请先登录。

登录