Recorded Future 专家解释了人工智能将如何用于网络攻击。

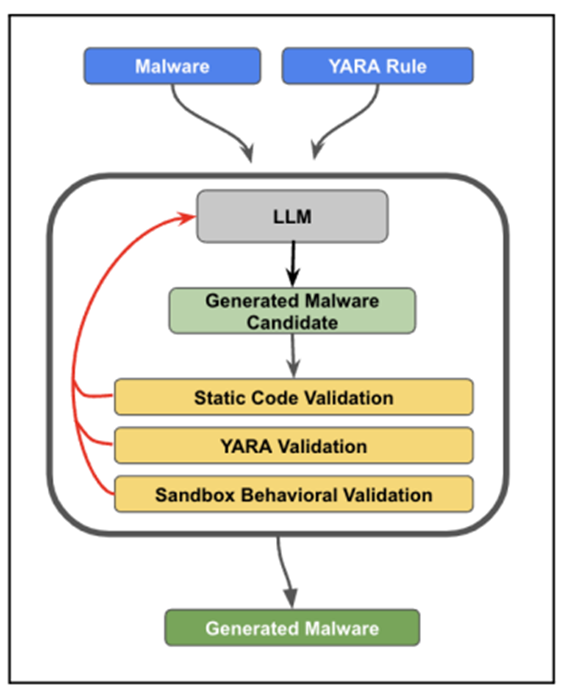

信息技术安全公司Recorded Future的 一份 新报告描述了如何使用大型语言模型 ( LLM ) 来创建能够绕过YARA规则的自我改进恶意软件。

实验表明,生成式AI可以有效修改恶意软件源代码以逃避基于YARA规则的检测,从而降低检测的可能性。网络犯罪分子已经在探索这种方法,以生成恶意代码片段、创建网络钓鱼电子邮件并对潜在目标进行侦察。

例如,该公司要求 LLM 修改已知 STEELHOOK 恶意软件的源代码,以绕过检测,而不会丢失功能或出现语法错误。由此产生的修改后的恶意软件能够使用简单的 YARA 规则逃避检测。

然而,这种规则方法存在与模型一次可以处理的文本量相关的限制,因此很难使用大型代码库。然而,根据 Recorded Future 的说法,网络犯罪分子可以通过将文件上传到 LLM 工具来绕过此限制。

研究还表明,2024 年人工智能最有可能的恶意使用将是深度造假并影响运营:

- 使用开源工具创建的 Deepfakes 可用于冒充高管,而人工智能生成的音频和视频可以增强社会工程活动。

- 为影响力运营创建内容的成本将大幅下降,从而使克隆网站或创建虚假媒体变得更加容易。人工智能还可以帮助恶意软件开发人员绕过检测和攻击者进行侦察活动,例如识别易受攻击的工业系统或定位敏感目标。

除了修改恶意软件之外,人工智能还可用于创建知名人士的深度伪造品,并通过模仿合法网站进行影响力操作。生成式人工智能有望加速攻击者对关键基础设施进行侦察并获取可用于后续攻击的信息的能力。

建议组织为此类威胁做好准备,将其领导人的声音和外表、网站和品牌以及公共形象视为攻击面的一部分。我们还应该期待更复杂地使用人工智能来创建逃避检测的恶意软件。

发表评论

您还未登录,请先登录。

登录